Wait and see, czyli trudny związek prawa z AI

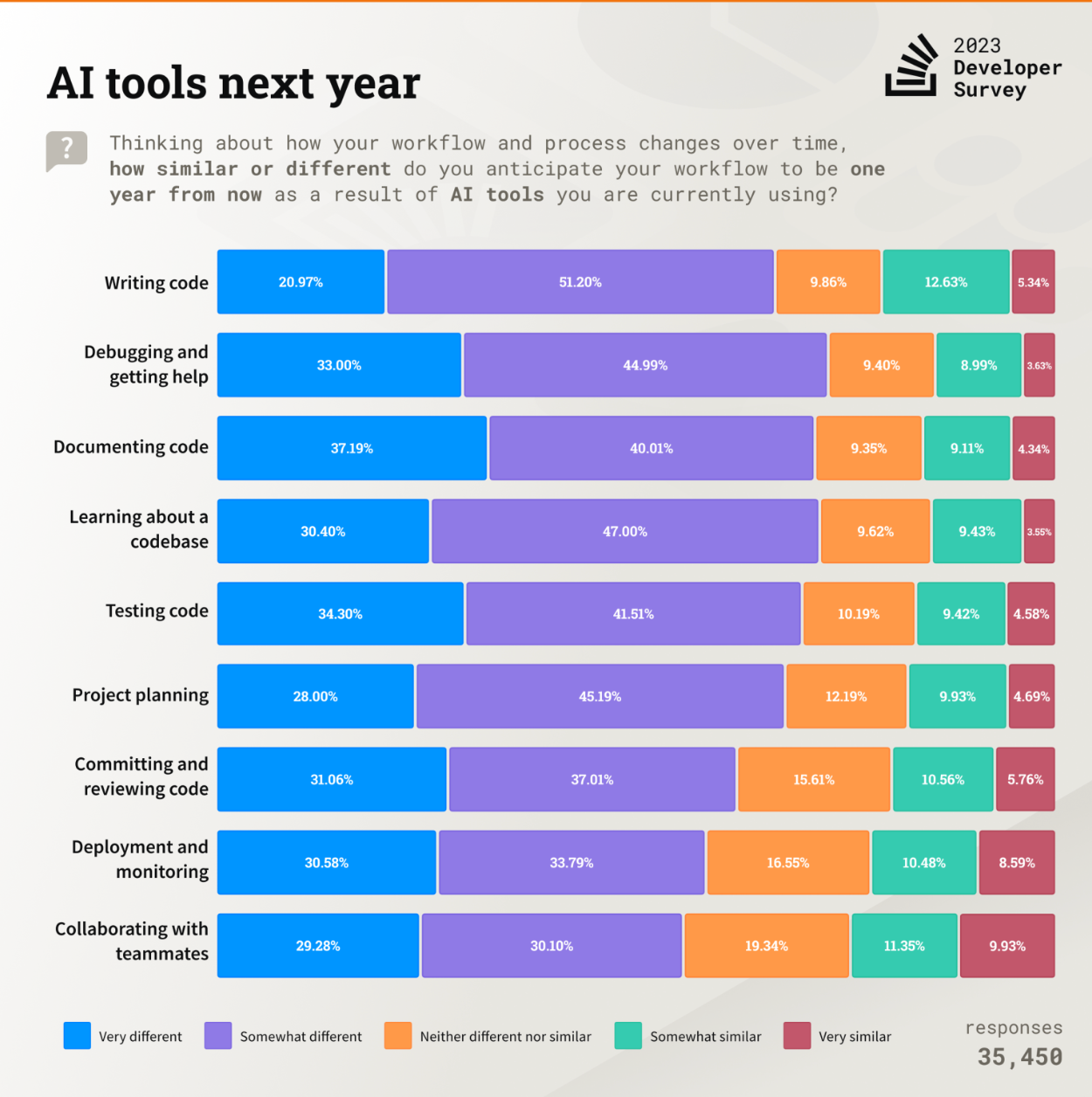

The Stack Overflow zrobiło badanie opinii w środowisku software developerów.

Zdecydowana większość z 36 tyś. ankietowanych stwierdziła, że generatywna AI w ciągu najbliższego roku wpłynie na ich organizację pracy nad oprogramowaniem.

Nie jest też zaskoczeniem, że na ponad 39 tyś respondentów, circa 70% podchodzi do kodu wygenerowanego przez AI z dużym sceptycyzmem.

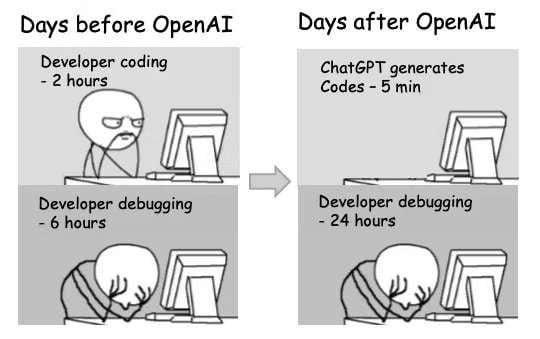

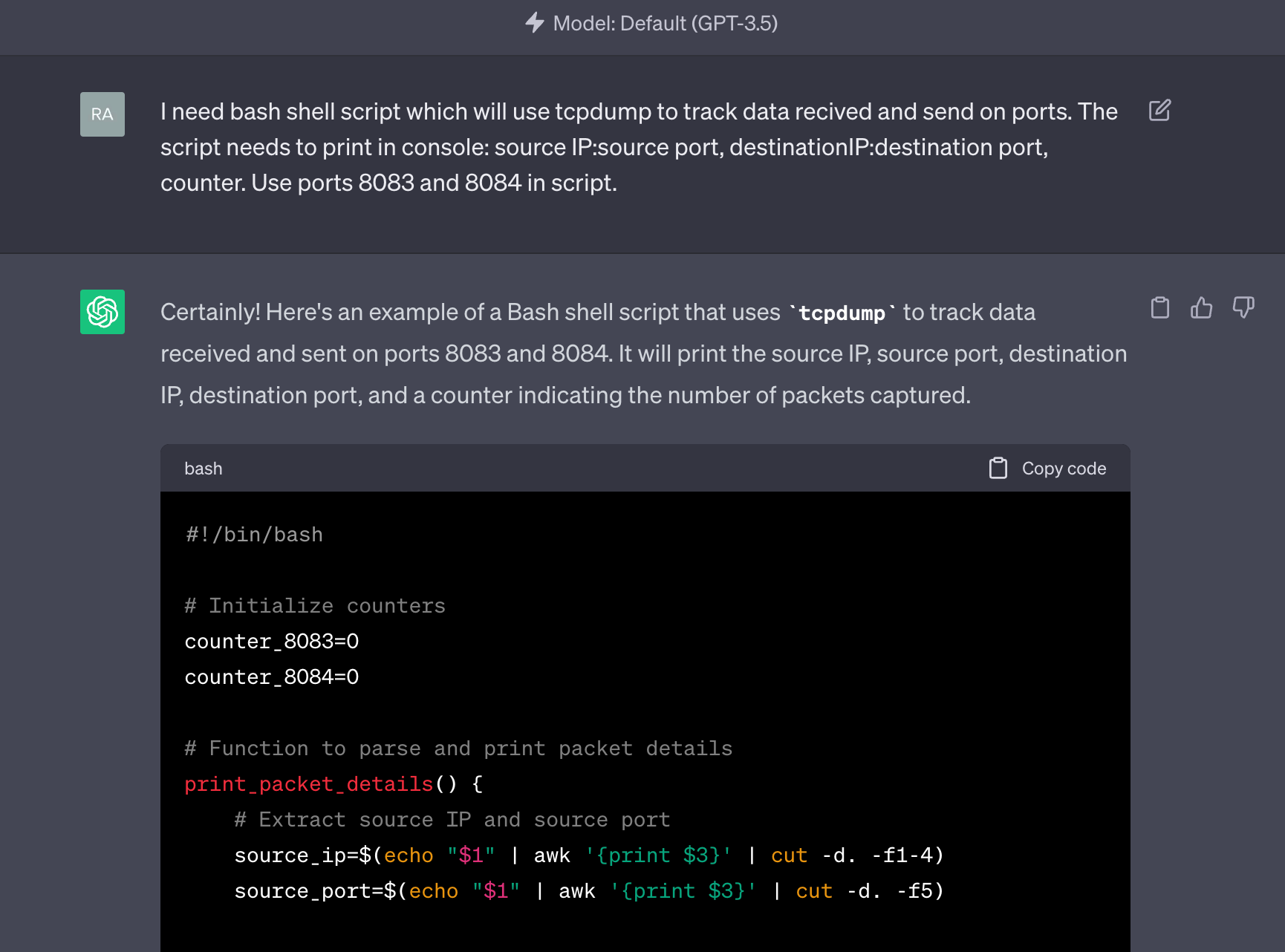

Żartobliwie rzecz ujmując, przygody programistów z chatem GPT często wyglądają tak:

Summa summarum, oni uczą się promptu i doskonalą w cierpliwości, a chat uczy się programować. I tu pojawia się problem autorstwa. Skoro chat w zasadzie “uczy się” programować, m.in. dzięki komendom, uwagom i wskazówkom programisty, to czyj jest kod?

Poszukując odpowiedzi na to pytanie, zacznijmy od podstaw, czyli działania samego chatu.

Jak działa chat GPT?

GPT (“Generative Pre-training Transformer”) to rodzaj modelu językowego (LLM), który wykorzystuje big data i machine learning do generowania tekstu.

ChatGPT z kolei, to po prostu chatbot używający architektury GPT do tworzenia odpowiedzi na dane wejściowe użytkownika w czasie rzeczywistym. Innymi słowy, chatGPT jest oprogramowaniem zdolnym do wykonywania zadania, które zazwyczaj wymaga inteligencji człowieka. Co ważne, kiedy użytkownik wprowadza prompt (komendę), ChatGPT generuje odpowiedź z uwzględnieniem kontekstu konwersacji i wszystkich poprzednio wprowadzonych danych. Jest to odbicie procesu uczenia się ludzi - GPT wykazuje w rozmowie pamięć, a jego odpowiedzi są bliskie ludzkim, bo korespondują ze sobą.

Świetnie i łopatologicznie zobrazował to zjawisko Justin Gage w swoim newsletterze Technically:

The easiest way to understand text generation is to think about a really good friend of yours (assuming you have one). At some point if you hang out enough, you get a good feel for their mannerisms, phrasing, and preferred topics of conversation - to the point where you might be able to reliably predict what they’re going to say next(“finishing each other’s sentences”). That’s exactly how GPT-3 and other models like it work - they learn a lot (I mean, like really a lot) about text, and then based on what they’ve seen so far, predict what’s coming next.

Funkcją Chatu GPT jest więc udzielenie jak najbardziej statystycznie wiarygodnej odpowiedzi.

Jak programiści korzystają z chatu GPT?

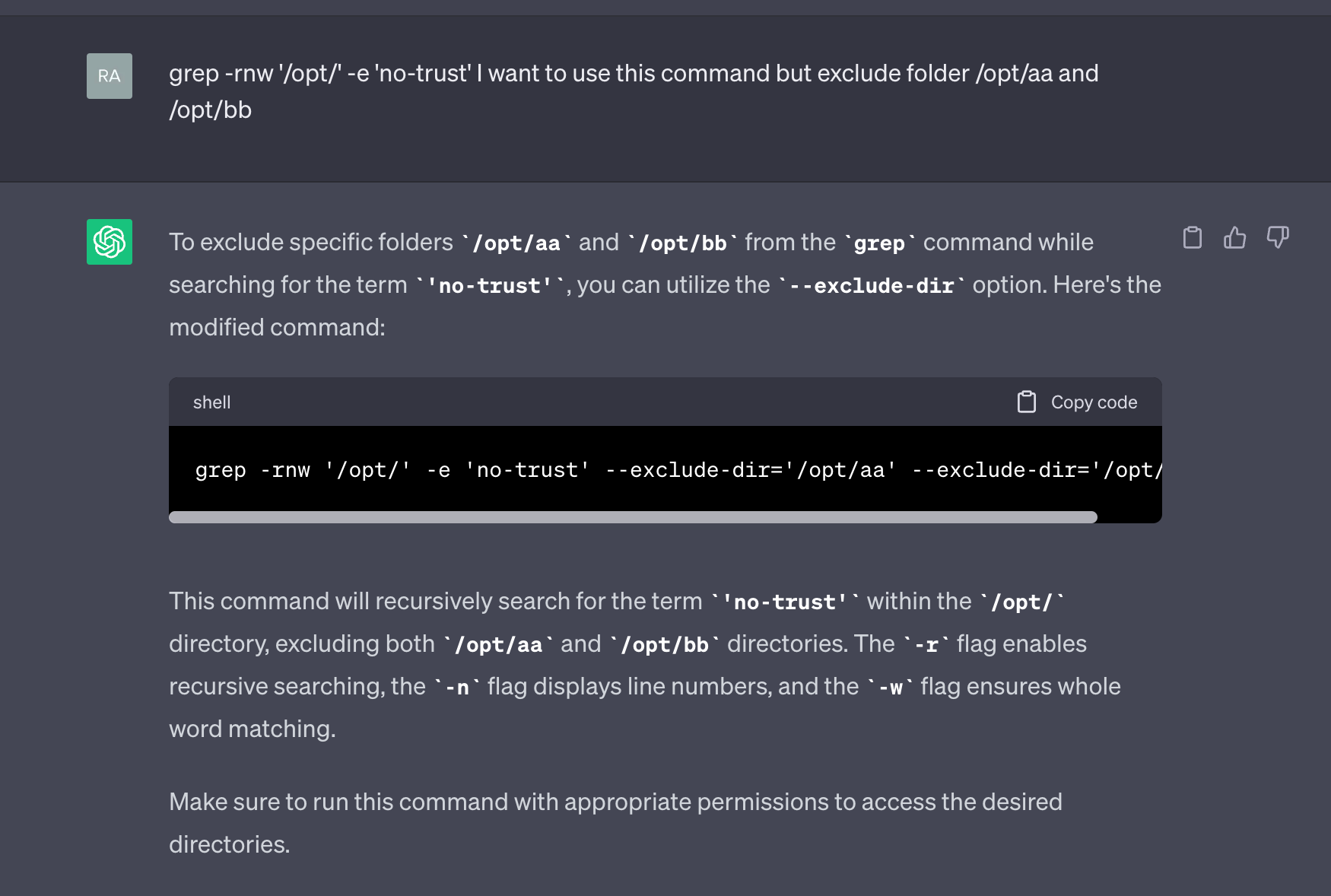

ChatGPT potrafi generować kod programistyczny w odpowiedzi na zadany problem.

Może to wyglądać w ten sposób:

Programista wyjaśnia funkcję, jaką ma spełnić linijka kodu, a ChatGPT przedstawia kod i streszczenie jego zastosowania. Skuteczne wyjaśnienie funkcji przez programistę wymaga ewidentnie wiedzy.

Programista może używać różnych promptów, np.:

- znajdź błędy w moim kodzie: ....

- wyjaśnij do czego służy ten fragment kodu: ....

- zwróć mi funkcję X w języku programowania Y...

- wygeneruj dokumentację API

- napisz test automatyczny, który XYZ...

- Zaproponuj ulepszenia dla następującego kodu [...] w celu zwiększenia testowalności: [...].

- Zidentyfikuj możliwości zastosowania wzorca X w podanym kodzie: ...

W odpowiedzi na niektóre z tych poleceń, chatGPT bezdyskusyjnie oddaje programy komputerowe: zestawy instrukcji lub rozkazów, przeznaczonych do użycia bezpośrednio lub pośrednio w komputerze w celu osiągnięcia danego rezultatu.

Już teraz jest nie tylko doraźną pomocą dla programisty, ale może być generatorem całych aplikacji, dzięki wtyczce GPT-engineer (imponujące 😯).

Czy AI możemy uznać za twórcę?

Skoro chatGPT generuje programy komputerowe w zasadzie nieodróżnialne od tych wykonanych przez ludzi, to czy możemy w świetle prawa uznać go za twórcę?

Jednoznaczna odpowiedź polskiego prawa autorskiego brzmi NIE: w naszym porządku prawnym za utwór można uznać jedynie rezultat działalności intelektu człowieka, i do człowieka należy domena twórczości.

Czy w takim razie użytkownik chatu GPT jest twórcą kodu wygenerowanego na podstawie promptu?

Wiemy już, że prawa autorskie mogą przysługiwać tylko człowiekowi - twórcy utworu.

Na gruncie art.1 polskiej ustawy o prawie autorskim utworem jest każdy przejaw działalności twórczej o indywidualnym charakterze, ustalony w jakiejkolwiek postaci, niezależnie od wartości, przeznaczenia i sposobu wyrażenia.

O tym, co właściwie oznacza “działalność twórcza” mówi nam orzecznictwo, np.:

Praca intelektualna o charakterze twórczym jest przeciwieństwem pracy o charakterze technicznym, która polega na wykonywaniu czynności wymagających jedynie określonej wiedzy i sprawności oraz użycia określonych narzędzi, surowców i technologii. Cechą pracy o charakterze technicznym jest przewidywalność i powtarzalność osiągniętego rezultatu. Proces tworzenia, w przeciwieństwie do pracy technicznej, polega na tym, że rezultat podejmowanego działania stanowi projekcję wyobraźni osoby, od której pochodzi.

-wyrok SN z dn. 25 stycznia 2006 r., sygn. akt I CK 281/05

Bez wątpienia napisanie programu komputerowego przez programistę wymaga wiedzy i sprawności (znajomości języka programowania), tak samo jak umiejętne używanie chatu GPT (musimy nauczyć się parametryzacji promptu tak, aby uzyskać oczekiwany rezultat). Jednak wynik promptu może być zaskakujący i odpowiedź chatu może być różna w odpowiedzi na ten sam prompt. Wiemy jednak, że AI twórcą kodu w świetle prawa nie będzie, więc co z użytkownikiem?

Wracając do orzeczenia wyżej, napisanie programu przez programistę wymaga też wyobraźni, ponieważ istnieje niezliczona ilość sposobów dojścia do określonego rozwiązania IT.

Co za tym idzie, prawo autorskie chroni również np.: dokumentację projektową programu, jeżeli jest na tyle szczegółowa, że inny programista machinalnie na jej podstawie napisał działający program. W efekcie to autorowi dokumentacji, a nie programiście będą przysługiwały prawa autorskie do programu, ponieważ to ten pierwszy, a nie ten drugi doszedł do rozwiązania. Innymi słowy, twórca dokumentacji nadał programowi indywidualny charakter, o którym mówi przytoczony wcześniej art. 1 ustawy.

Z drugiej strony, ochronie prawnoautorskiej nie podlegają pomysły, o czym ustawa wypowiada się w ten sposób:

Ochroną objęty może być wyłącznie sposób wyrażenia; nie są objęte ochroną odkrycia, idee, procedury, metody i zasady działania oraz koncepcje matematyczne.

Pomysł musi być więc jakoś wyrażony. Mamy w tym temacie wyrok SN z 2006 roku (sygn. akt IV CSK 25/06), gdzie uznano że tzw. treatment scenariusza filmowego (streszczenie fabuły i postaci, schemat akcji) powinien być uznany za dzieło w rozumieniu prawa autorskiego i podlegać ochronie prawnoautorskiej. Sąd Najwyższy uznał, że takie "treatmenty" mogą być chronione, jeżeli stanowią "własny intelektualny twór" autora. Pomimo iż są one na wstępnym etapie twórczości, mogą spełniać kryterium oryginalności, niezależnie od tego, czy zostały później rozwinięte w pełne scenariusze, czy też nie. W rezultacie, producent filmu, który wykorzysta oryginalne pomysły i koncepcje zawarte w "treatment", bez uzyskania zgody i bez wypłaty wynagrodzenia autorowi, może zostać pociągnięty do odpowiedzialności za naruszenie praw autorskich.

Podsumowując te dwa orzeczenia - decydujący jest wymiar wkładu twórczego użytkownika.

Pytanie kto jest twórcą kodu powstałego na podstawie promptu można wobec tego sprowadzić do kwestii, czy wpisując do terminala chatu prompt użytkownik przesądza o nadaniu wygenerowanej treści cech o których mówi art. 1 ustawy?

Jeżeli użytkownik chatu formułuje w terminalu jedynie ogólnie pożądany efekt to nie ma mowy, żeby był twórcą treści wygenerowanej przez oprogramowanie wyuczone na zbiorach zewnętrznych danych.

Ale jeżeli proces promptowania jest złożony, a użytkownik dokonuje nie tylko zmian promptu aż powstanie dzieło bliskie jego wizji, lecz również modyfikuje wypluty przez chat kod - można by bez wątpienia rozważać powstanie utworu, bo wymiar pracy twórczej jest wtedy znaczący i może przesądzać o indywidualnym charakterze dzieła. Mielibyśmy wtedy do czynienia z 3 etapami powstania dzieła:

- fazą koncepcji (z udziałem użytkownika)

- fazą wykonawczą (bez jego udziału)

- fazą redakcyjną (z udziałem użytkownika).

Taka mniej więcej sytuacja pojawiła się w sprawie wyrokowanej przez TSUE C-145/10 Eva-Maria Painer przeciwko Standard Verlags GmbH.

Kazus Pani Painer może wydawać się mocno oderwany od świata technologii, bo dotyczy zdjęć portretowych.

Eva-Maria Painer jest profesjonalną fotografką, która w 1998 roku zrobiła zdjęcia Nataschy Kampusch, wówczas 10-letniej dziewczynki. W 1998 roku Natascha została porwana i przetrzymywana w niewoli przez 8 lat. Kiedy historia Nataschy stała się powszechnie znana, wiele mediów używało zdjęć Painer w swoich artykułach, nie uzyskując wcześniej jej zgody.

Standard Verlags GmbH, jedno z przedsiębiorstw medialnych, które wykorzystało jej zdjęcia, argumentowało, że użycie zdjęć było dozwolone na mocy wyjątku od praw autorskich dotyczącego raportowania na tematy aktualne.

To, co nas interesuje, to nie ten wyjątek, ale analiza TSUE w kontekście indywidualnego charakteru zdjęcia portretowego. Dlaczego? Ponieważ wykonywanie fotografii portretowej odrobinę przypomina współpracę z chatem GPT. Kiedy fotograf wykonuje portret, dokonuje kreatywnych wyborów. W fazie przygotowawczej może np. dokonać wyboru inscenizacji, pozy osoby fotografowanej lub oświetlenia. W fazie wykonawczej może dokonać wyboru kadrowania, czy kąta ujęcia. Poprzez dokonywanie tych różnych wyborów autor fotografii portretowej może odcisnąć na tworzonym dziele indywidualne piętno twórcy.

Analogicznie, przygotowując prompt dokonujemy kreatywnych wyborów, a późniejsze komendy, mające na celu alternatywne wyniki, wpływają na stan wiedzy chatu. To, jaki będzie efekt fotografii portretowej jest po części niezależne od fotografa - nie zmieni całkowicie aparycji osoby portretowanej i tak samo twórca promptu nie wpłynie definitywnie i całkowicie na kształt wygenerowanej przez AI treści. Ale, tak jak fotograf w fazie retuszu, dokonuje kreatywnych wyborów, tak i użytkownik chata w fazie redakcyjnej może dokonać ostatecznych poprawek.

Przekładając to orzeczenie na świat technologii, skala kreatywnych wyborów użytkownika chatu może przesądzić o tym, że nada wygenerowanej treści cechy o których mówi art. 1 ustawy o prawie autorskim.

O tym, czy to przypuszczenie znajdzie swoje miejsce w rzeczywistości, zadecydują wkrótce nowe przepisy prawa, a później - z większą mocą - sądy i orzecznictwo. Piszę wkrótce, ale nie mam na myśli krótkiego odcinka czasu, lecz perspektywę kilku lat. Pamiętajmy, że prawo nie może być procesowane szybko - wymaga prognostyki, dyskursu i konsultacji społecznych. Natomiast najbliższe wydarzenia na świecie to wyrastanie jak grzyby po deszczu spraw, w których użytkownicy będą domagać się ochrony prawnoautorskiej wytworów stworzonych z użyciem AI, co da stymulację do rozwoju prawa.

Jestem developerem, jak postępować używając chatuGPT, żeby uzasadnić kiedyś ochronę prawnoautorską?

Po pierwsze dokumentować, po drugie dokumentować i po trzecie dokumentować. Proces twórczy warto utrwalić na cele dowodowe, w tym proces przygotowywania promptu.

Ciekawe rozwiązania przynoszą ciekawe czasy (i na odwrót)

Problem z dzisiejszego odcinka to tylko zajawka fali zagadnień, które będą niemałym wyzwaniem dla prawników.

Według Bena Goertzela, znanego najbardziej z zainicjowania prac nad Sophia the Robot, generatywna AI ma potencjał do przeorganizowania naszego społeczeństwa w dziedzinie pracy. Jego zdaniem rację bytu zachowają z czasem jedynie zawody wymagające niebywałej wyobraźni oraz te, w których kluczowy jest kontakt człowieka z człowiekiem.

Bardzo polecam Ci Czytelniku zapoznanie się z projektem badawczo-biznesowym Goertzela (SingularityNET), który łączy sztuczną inteligencję i blockchain w celu stworzenia zdecentralizowanego otwartego rynku dla sztucznej inteligencji.

SingularityNET ma przyczynić się do powstania AGI, czyli Artificial General Intelligence. W przeciwieństwie do obecnie dominujących form AI, które są skoncentrowane na konkretnych zadaniach (tzw. Narrow AI, czyli "wąska sztuczna inteligencja"), AGI miałaby umiejętność zrozumienia, nauki i zastosowania wiedzy w różnych kontekstach, tak jak robią to ludzie.

Do technologii takich jak chatGPT w relacji do AGI odniósł się ostatnio Howard Rheingold, socjolog, który już w 1984 pisał o podobnych oprogramowaniach w książce “Tools for Thought: The History and Future of Mind-Amplifiers”:

They don’t understand. They do statistics. Think of them as thinking-knowledge tools. As mathematics and computers come to enable human minds to go places they were previously unable to explore, I see a lot of change coming from this symbiosis of machine learning and human production of words, images, sounds and code.

Sam Goertzel w niedawnym wystąpieniu "Singularity, Sparks of AGI in GPT" też dość celnie spunktował etap rozwoju chatuGPT:

If you have society of chats gpt, this society would never progress…

Trudno się z tym nie zgodzić. Tworzenie, np. strategii biznesowych wymaga adaptacyjności do zmieniających się warunków. Nie wystarczy zwykłe łączenie wzorców, powielanie tego, co zostało wcześniej sformułowane i szczypta statystyki.

Wystąpienie możesz obejrzeć na kanale Theories of Everything:

Wracając do SingularityNET, nie jestem odosobniona w wyobrażeniu takiego blockchain, na którym mam wirtualnego asystenta AI, pomagającego mi w pracy, m.in. twórczej, a wszelkie dane z tym związane są zabezpieczone łańcuchem. Jak prawo potraktuje takich asystentów (agentów, sobowtórów, wirtualnych odpowiedników - koncepcja może iść w różnym kierunku)? Czy będą w świetle prawa naszymi “pracownikami”, a my będziemy właścicielami praw do tego, co wytworzą? Czy będą mieć osobowość prawną podobną do spółek? …

Ciekawe rozwiązania przynoszą ciekawe czasy i na odwrót, więc let’s wait and see.